BERT与GPT:自然语言处理的里程碑与应用分析

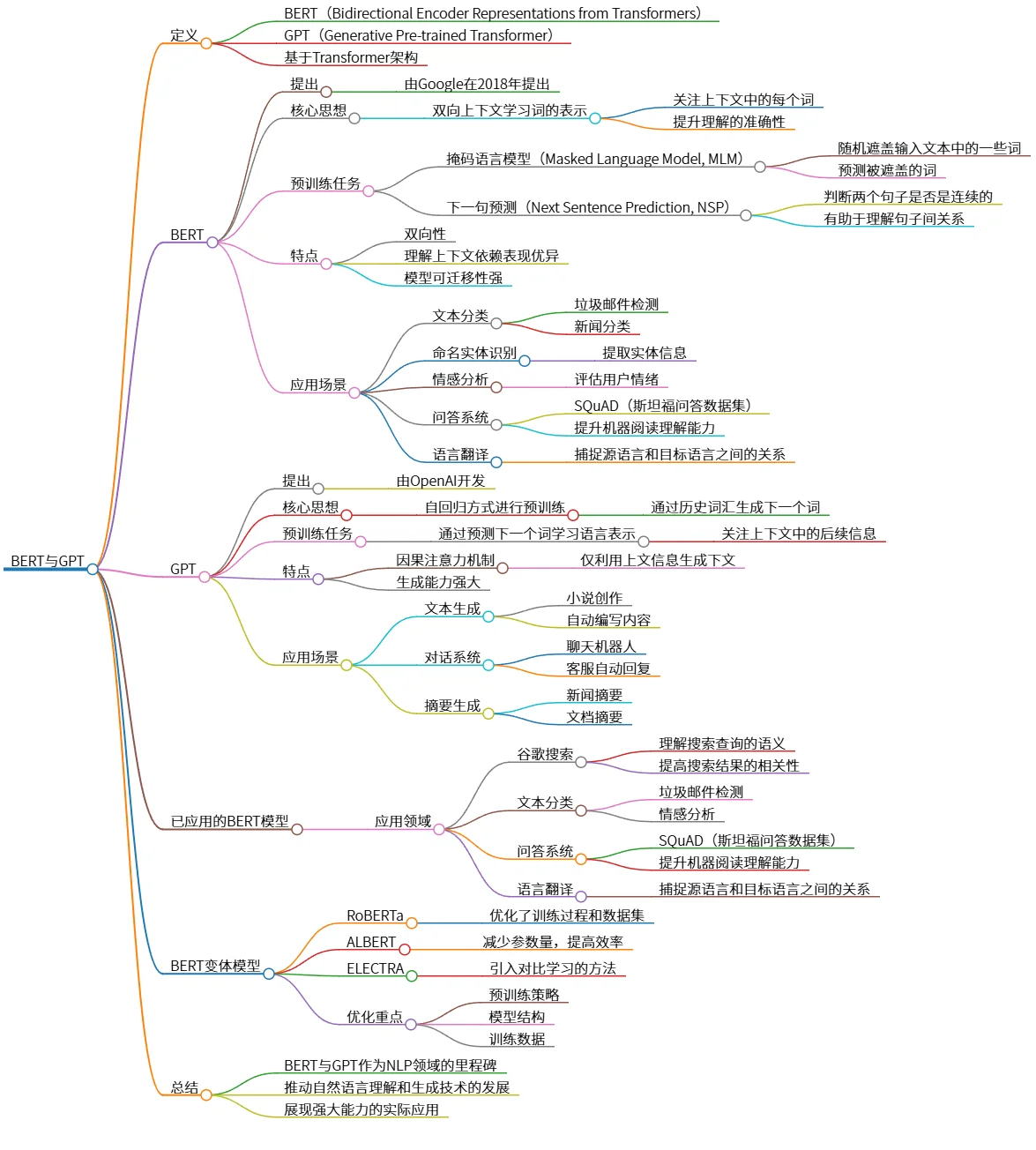

该思维导图介绍了BERT和GPT的定义、核心思想及预训练任务。BERT由Google提出,重点在于双向上下文学习,广泛应用于文本分类和情感分析等领域。GPT由OpenAI开发,采用自回归方式进行文本生成,适用于对话系统和摘要生成。还提到BERT的应用场景及其变体模型,如RoBERTa和ALBERT,强调了BERT与GPT在自然语言处理领域的重要性和实际应用价值。

源码

# BERT与GPT

## 定义

- BERT(Bidirectional Encoder Representations from Transformers)

- GPT(Generative Pre-trained Transformer)

- 基于Transformer架构

## BERT

### 提出

- 由Google在2018年提出

### 核心思想

- 双向上下文学习词的表示

- 关注上下文中的每个词

- 提升理解的准确性

### 预训练任务

- 掩码语言模型(Masked Language Model, MLM)

- 随机遮盖输入文本中的一些词

- 预测被遮盖的词

- 下一句预测(Next Sentence Prediction, NSP)

- 判断两个句子是否是连续的

- 有助于理解句子间关系

### 特点

- 双向性

- 理解上下文依赖表现优异

- 模型可迁移性强

### 应用场景

- 文本分类

- 垃圾邮件检测

- 新闻分类

- 命名实体识别

- 提取实体信息

- 情感分析

- 评估用户情绪

- 问答系统

- SQuAD(斯坦福问答数据集)

- 提升机器阅读理解能力

- 语言翻译

- 捕捉源语言和目标语言之间的关系

## GPT

### 提出

- 由OpenAI开发

### 核心思想

- 自回归方式进行预训练

- 通过历史词汇生成下一个词

### 预训练任务

- 通过预测下一个词学习语言表示

- 关注上下文中的后续信息

### 特点

- 因果注意力机制

- 仅利用上文信息生成下文

- 生成能力强大

### 应用场景

- 文本生成

- 小说创作

- 自动编写内容

- 对话系统

- 聊天机器人

- 客服自动回复

- 摘要生成

- 新闻摘要

- 文档摘要

## 已应用的BERT模型

### 应用领域

- 谷歌搜索

- 理解搜索查询的语义

- 提高搜索结果的相关性

- 文本分类

- 垃圾邮件检测

- 情感分析

- 问答系统

- SQuAD(斯坦福问答数据集)

- 提升机器阅读理解能力

- 语言翻译

- 捕捉源语言和目标语言之间的关系

## BERT变体模型

- RoBERTa

- 优化了训练过程和数据集

- ALBERT

- 减少参数量,提高效率

- ELECTRA

- 引入对比学习的方法

- 优化重点

- 预训练策略

- 模型结构

- 训练数据

## 总结

- BERT与GPT作为NLP领域的里程碑

- 推动自然语言理解和生成技术的发展

- 展现强大能力的实际应用

图片